|

- 이재길 교수팀, 다양한 데이터 변화 정도에 적응하는 연속 학습 기술 개발 - 지난 7월 최고권위 국제학술대회 ‘국제머신러닝학회(ICML) 2024’에서 발표 - 다양한 종류의 이미지 분류 문제에서 최신 방법 대비 최대 14% 정확도 향상

▲KAIST 전산학부 이재길 교수, 김도영 박사과정

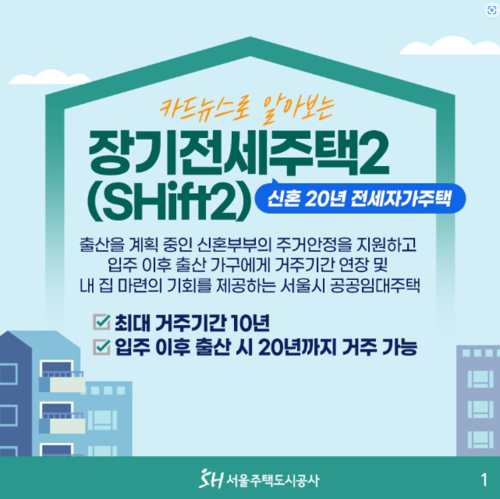

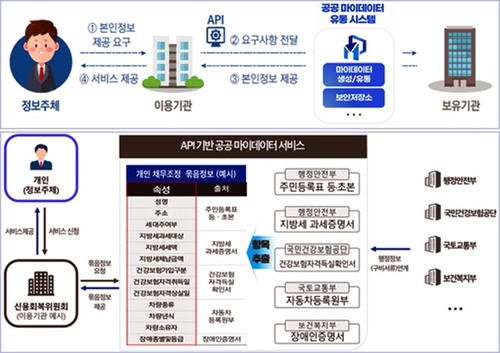

▲연구팀에서 개발한 적응적 프롬프팅 방법론의 동작 개념도

인공지능 심층신경망 모델의 추천시스템에서 시간이 지남에 따라 사용자의 관심이 변하더라도 변화한 관심 또한 효과적으로 학습할 수 있는 인공지능 훈련 기술 개발이 요구되고 있다. 사용자의 관심이 급변하더라도 기존의 지식을 유지하며 새로운 지식을 축적하는 인공지능 연속 학습을 가능하게 하는 기술이 KAIST 연구진에 의해 개발되었다.

KAIST(총장 이광형)는 전산학부 이재길 교수 연구팀이 다양한 데이터 변화에 적응하며 새로운 지식을 학습함과 동시에 기존의 지식을 망각하지 않는 새로운 연속 학습(continual learning) 기술을 개발했다고 5일 밝혔다.

최근 연속 학습은 훈련 비용을 줄일 수 있도록 프롬프트(prompt) 기반 방식이 대세를 이루고 있다. 각 작업에 특화된 지식을 프롬프트에 저장하고, 적절한 프롬프트를 입력 데이터에 추가해 심층신경망에 전달함으로써 과거 지식을 효과적으로 활용한다.

이재길 교수팀은 기존 접근방식과 다르게 작업 간의 다양한 변화 정도에 적응할 수 있는 적응적 프롬프팅(adaptive prompting)에 기반한 연속 학습 기술을 제안했다. 현재 학습하려는 작업이 기존에 학습하였던 작업과 유사하다면 새로운 프롬프트를 생성하지 않고 그 작업에 할당된 프롬프트에 추가로 지식을 축적한다. 즉, 완전히 새로운 작업이 입력될 때만 이를 담당하기 위한 새로운 프롬프트를 생성하도록 하고 연구팀은 새로운 작업이 들어올 때마다 클러스터링이 적절한지 검사해 최적의 클러스터링 상태를 유지하도록 했다.

연구팀은 이미지 분류 문제에 대해 작업 간의 다양한 변화 정도를 가지는 실세계 데이터를 사용해 방법론을 검증했다. 이 결과 연구팀은 기존의 프롬프트 기반 연속 학습 방법론에 비해, 작업 간의 변화 정도가 항상 큰 환경에서는 최대 14%의 정확도 향상을 달성했고, 작업 간의 변화가 클 수도 있고 작을 수도 있는 환경에서는 최대 8%의 정확도 향상을 달성했다.

또한, 제안한 방법에서 유지하는 클러스터 개수가 실제 유사한 작업의 그룹 개수와 거의 같음을 확인했다. 온라인 클러스터링을 수행하는 비용이 매우 작아 대용량 데이터에도 쉽게 적용할 수 있다.

연구팀을 지도한 이재길 교수도 "연속 학습 분야의 새로운 지평을 열 만한 획기적인 방법이며 실용화 및 기술 이전이 이뤄지면 심층 학습 학계 및 산업계에 큰 파급효과를 낼 수 있을 것이다ˮ고 말했다.

KAIST 전산학부 김도영 박사과정 학생이 제1 저자, 이영준 박사과정, 방지환 박사과정 학생이 제4, 제6 저자로 각각 참여한 이번 연구는 최고권위 국제학술대회 `국제머신러닝학회(ICML) 2024'에서 지난 7월 발표됐다. (논문명 : One Size Fits All for Semantic Shifts: Adaptive Prompt Tuning for Continual Learning)

한편, 이 기술은 과학기술정보통신부 재원으로 정보통신기획평가원의 지원을 받아 사람중심인공지능핵심원천기술개발사업 AI학습능력개선기술개발 과제로 개발한 연구성과 결과물(2022-0-00157, 강건하고 공정하며 확장 가능한 데이터 중심의 연속 학습)이다.

용어 설명: ● 심층신경망(deep neural network): 인공신경망은 기계 학습과 인지과학에서 생물학의 신경망(동물의 중추신경계중 특히 뇌)에서 영감을 얻은 통계학적 학습 알고리즘이다. 인공신경망은 시냅스의 결합으로 네트워크를 형성한 인공 뉴런(노드)이 학습을 통해 시냅스의 결합 세기를 변화시켜, 문제 해결 능력을 가지는 모델 전반을 가리킨다. [한국어 위키피디아 발췌]. 인공 뉴런이 여러 층으로 구성된 인공신경망을 심층신경망이라 부른다. ● 심층 학습(deep learning): 심층신경망을 훈련하여 예측 모델로 활용하는 방식 전반을 가리킨다. ● 연속 학습(continual learning): 심층신경망 모델을 새로운 데이터를 기반으로 지속해서 학습하는 심층 학습 분야이다. 연속 학습은 치명적 망각(catastrophic forgetting)을 방지해야 한다. 이는 새로운 데이터의 지식을 습득하면서 앞서 습득한 지식을 망각하지 말아야 함을 의미한다. 한번 배운 것을 잊지 않고 활용하기 위한 기술이라 평생 학습(lifelong learning)이라고도 불린다. ● 클러스터링(clustering): 주어진 데이터들의 특성을 고려해 유사한 데이터들이 같은 그룹(클러스터)에 속하고 다른 데이터들이 다른 그룹에 속하도록 그룹을 정의하는 비지도 학습 방식이다.

<저작권자 ⓒ 대한건설경제 무단전재 및 재배포 금지>

댓글

|

많이 본 기사

|